为什么会超简单

借助ansible简化了CDH6部署工作的大部分内容,也降低了手工操作失误的概率,今天实战的内容,是在一台安装了ansible的电脑上(苹果或Linux操作系统)运行ansible脚本,远程操作一台CentOS服务器,在上面部署CDH6,并操作验证本次部署是否成功。

ansible学习

如果您想了解ansible,请参考《ansible2.4安装和体验》

为什么要部署单机版CDH6

主要是用来做为大数据技术的学习和开发的环境,并不适合生产;

实战简述

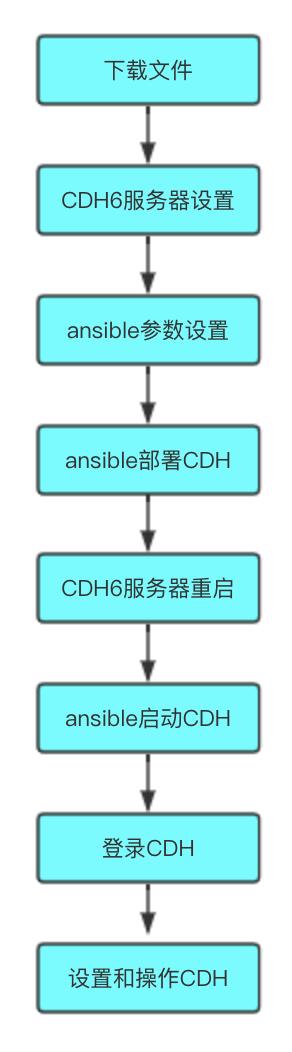

本次实战内容:部署、启动、验证,整个过程如下图所示:

全文大纲

本文由以下章节组成:

1. 环境信息;

2. 下载文件;

3. 文件摆放;

4. CDH机器设置;

5. ansible参数设置;

6. 部署;

7. 重启CDH服务器

8. 启动;

9. 设置;

10. 修复问题;

11. 体验;

环境信息

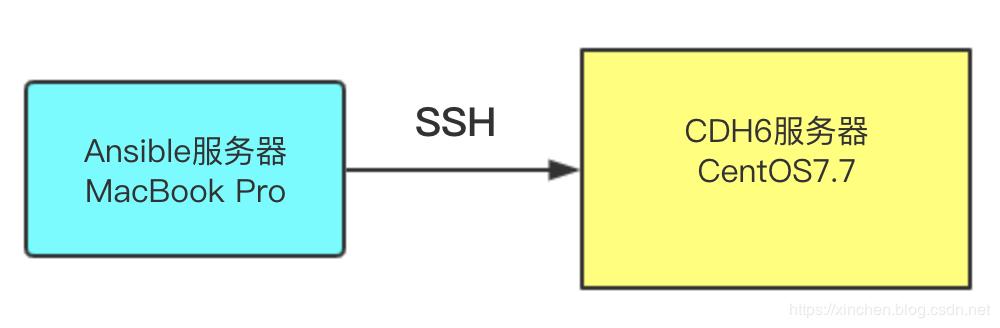

本次实战的操作过程如下图所示,安装ansible2.9版本的MabBook Pro电脑作为ansible服务器,执行playbook脚本,对一台CentOS服务器进行远程操作,完成CDH6的部署和启动:

上图蓝色背景的电脑,可以是苹果操作系统,也可以是Linux操作系统,黄色背景的电脑要用来运行CDH6,必须是CentOS7.7操作系统(实在对不起,我这条件有限,别的系统没有试过)

整个实战涉及的环境版本信息如下:

- ansible服务器:macOS Catalina 10.15(实测用CentOS7.7也成功)

- CDH服务器:CentOS Linux release 7.7.1908

- cm版本:6.1.0

- parcel版本:6.1.1

- jdk版本:8u191

下载文件(ansible服务器)

本次实战用到的所有文件如下表所示:

上述11个文件的下载地址:

- jdk-8u191-linux-x64.tar.gz:Oracle官网可下,另外我将jdk-8u191-linux-x64.tar.gz和mysql-connector-java-5.1.34.jar一起打包上传到csdn,您可以一次性下载,地址:https://download.csdn.net/download/boling_cavalry/12098987

- mysql-connector-java-5.1.34.jar:maven中央仓库可下,另外我将jdk-8u191-linux-x64.tar.gz和mysql-connector-java-5.1.34.jar一起打包上传到csdn,您可以一次性下载,地址:https://download.csdn.net/download/boling_cavalry/12098987

- cloudera-manager-server-6.1.0-769885.el7.x86_64.rpm:https://archive.cloudera.com/cm6/6.1.0/redhat7/yum/RPMS/x86_64/cloudera-manager-server-6.1.0-769885.el7.x86_64.rpm

- cloudera-manager-daemons-6.1.0-769885.el7.x86_64.rpm:https://archive.cloudera.com/cm6/6.1.0/redhat7/yum/RPMS/x86_64/cloudera-manager-daemons-6.1.0-769885.el7.x86_64.rpm

- cloudera-manager-agent-6.1.0-769885.el7.x86_64.rpm:https://archive.cloudera.com/cm6/6.1.0/redhat7/yum/RPMS/x86_64/cloudera-manager-agent-6.1.0-769885.el7.x86_64.rpm

- CDH-6.1.1-1.cdh6.1.1.p0.875250-el7.parcel:https://archive.cloudera.com/cdh6/6.1.1/parcels/CDH-6.1.1-1.cdh6.1.1.p0.875250-el7.parcel

- CDH-6.1.1-1.cdh6.1.1.p0.875250-el7.parcel.sha:https://archive.cloudera.com/cdh6/6.1.1/parcels/CDH-6.1.1-1.cdh6.1.1.p0.875250-el7.parcel.sha256 (下载完毕后,将扩展名从.sha256改为.sha)

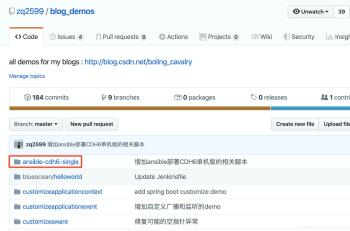

- hosts、ansible.cfg、cdh-single-install.yml、cdh-single-start.yml:这四个文件都保存在我的GitHub仓库,地址是:https://github.com/zq2599/blog_demos ,这里面有多个文件夹,上述文件在名为ansible-cdh6-single的文件夹中,如下图红框所示:

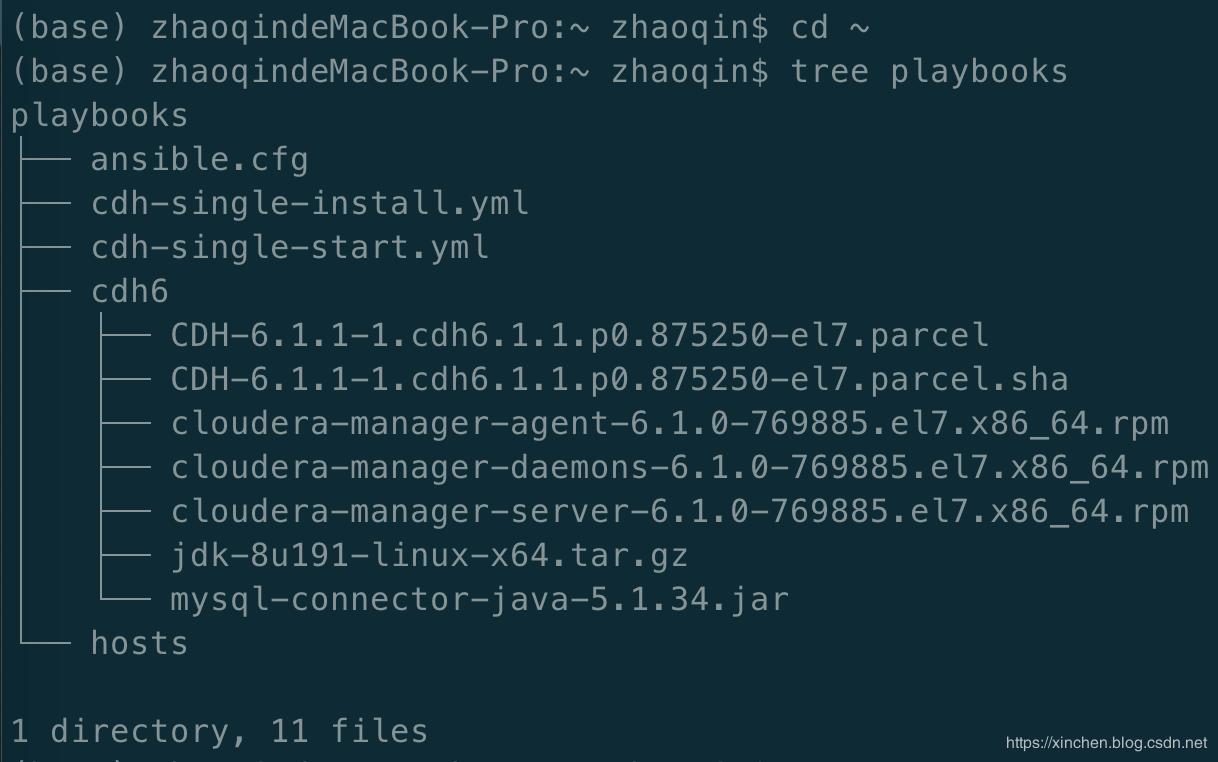

文件摆放(ansible服务器)

如果您已经下载好了上述11个文件,请按照如下位置摆放,这样才能顺利完成部署:

- 在家目录下新建名为playbooks的文件夹:mkdir ~/playbooks

- 把这四个文件放入playbooks文件夹:hosts、ansible.cfg、cdh-single-install.yml、cdh-single-start.yml

- 在playbooks文件夹里新建名为cdh6的子文件夹;

- 把这七个文件放入cdh6文件夹(即剩余的七个):jdk-8u191-linux-x64.tar.gz、mysql-connector-java-5.1.34.jar、cloudera-manager-server-6.1.0-769885.el7.x86_64.rpm、cloudera-manager-daemons-6.1.0-769885.el7.x86_64.rpm、cloudera-manager-agent-6.1.0-769885.el7.x86_64.rpm、CDH-6.1.1-1.cdh6.1.1.p0.875250-el7.parcel、CDH-6.1.1-1.cdh6.1.1.p0.875250-el7.parcel.sha

- 摆放完毕后目录和文件情况如下图,再次提醒,文件夹playbooks一定要放在家目录下(即:~/):

CDH服务器设置

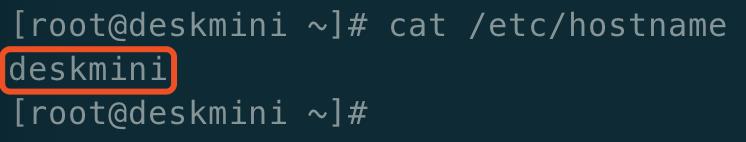

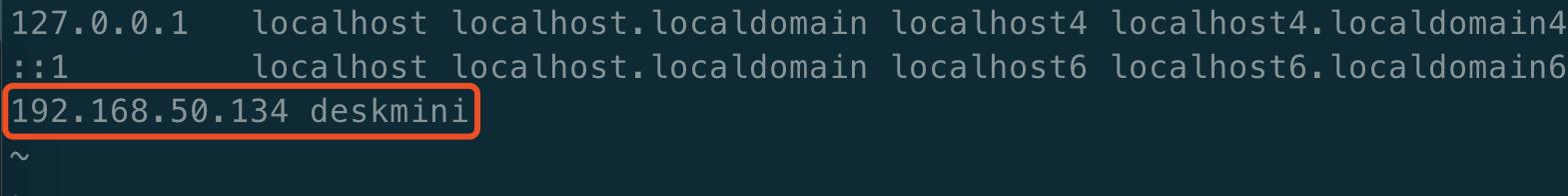

本次实战中,CDH服务器hostname是deskmini,IP地址是192.168.50.134,需要做以下操作:

- 请确保CDH服务器能SSH登录(用户名+密码);

- SSH登录到部署CDH的机器;

- 检查/etc/hostname文件是正确,如下图:

- 修改/etc/hosts文件,将自己的IP地址和hostname配置上去,如下图红框所示(事实证明这一步很重要,如果不做可能导致在部署时一直卡在"分配"阶段,看agent日志显示agent下载parcel的进度一直是百分之零):

ansible参数设置(ansible服务器)

ansible参数设置的操作设置很简单,就是把部署CDH的机器信息配置好即可,包括IP地址、登录账号、密码等,修改~/playbooks/hosts文件,内容如下所示,您需要根据自身情况修改deskmini、ansible_host、ansible_port、ansible_user、ansible_password:

[cdh_group]

deskmini ansible_host=192.168.50.134 ansible_port=22 ansible_user=root ansible_password=888888部署(ansible服务器)

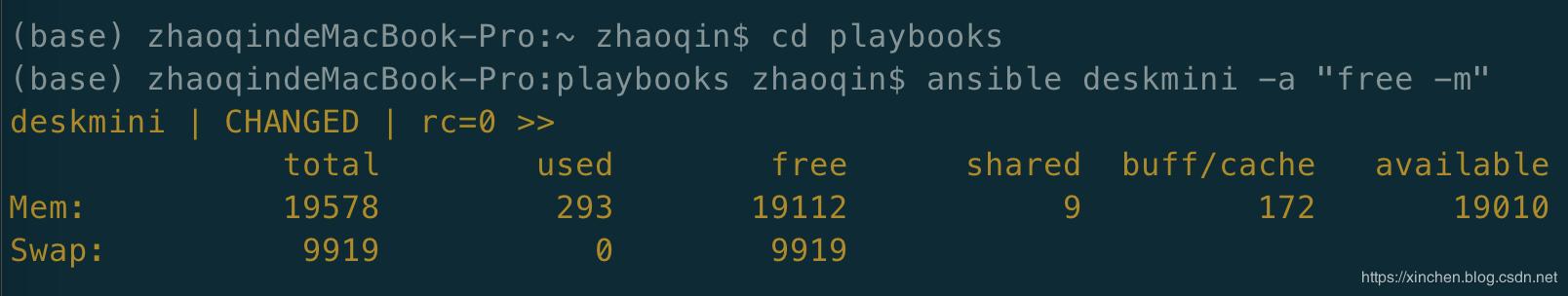

- 进入~/playbooks目录;

- 检查ansible远程操作CDH服务器是否正常,执行命令ansible deskmini -a "free -m",正常情况下显示CDH服务器的内存信息,如下图:

- 执行此命令开始部署:ansible-playbook cdh-single-install.yml

- 整个部署过程涉及在线安装、传递文件等耗时的操作,因此请耐心等待(半小时左右),我在部署期间遭遇网络问题导致失败退出,待网络正常后再重新执行上述操作即可,ansible保证了操作的幂等性;

- 部署成功如下图所示:

重启CDH服务器

由于修改了selinux和swap的设置,需要重启操作系统才能生效,因此请重启CDH服务器;

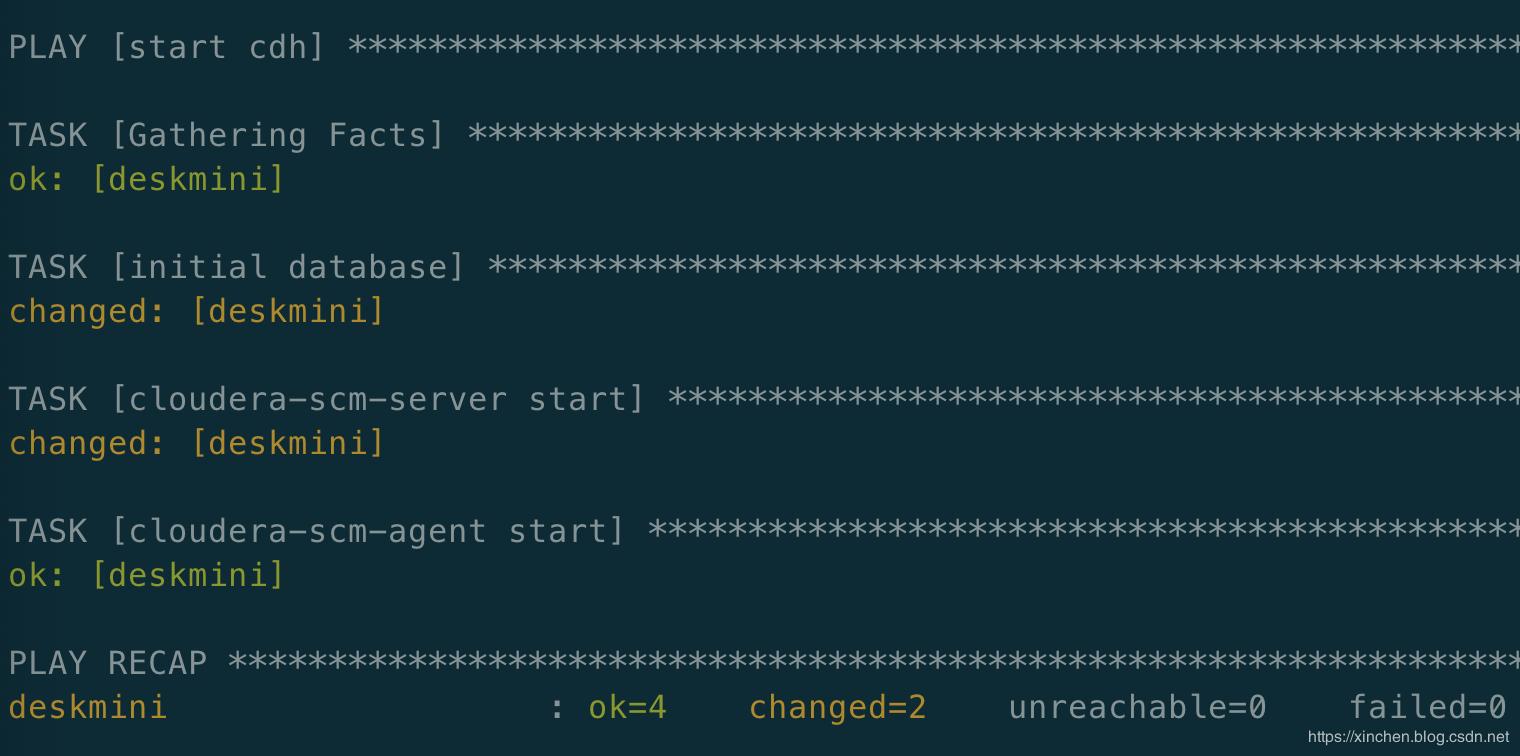

启动(ansible服务器)

- 等待CDH服务器重启成功;

- 登录ansible服务器,进入~/playbooks目录;

- 执行此命令开始初始化数据库,然后启动CDH:ansible-playbook cdh-single-start.yml

- 启动完成输出如下信息:

设置(网页)

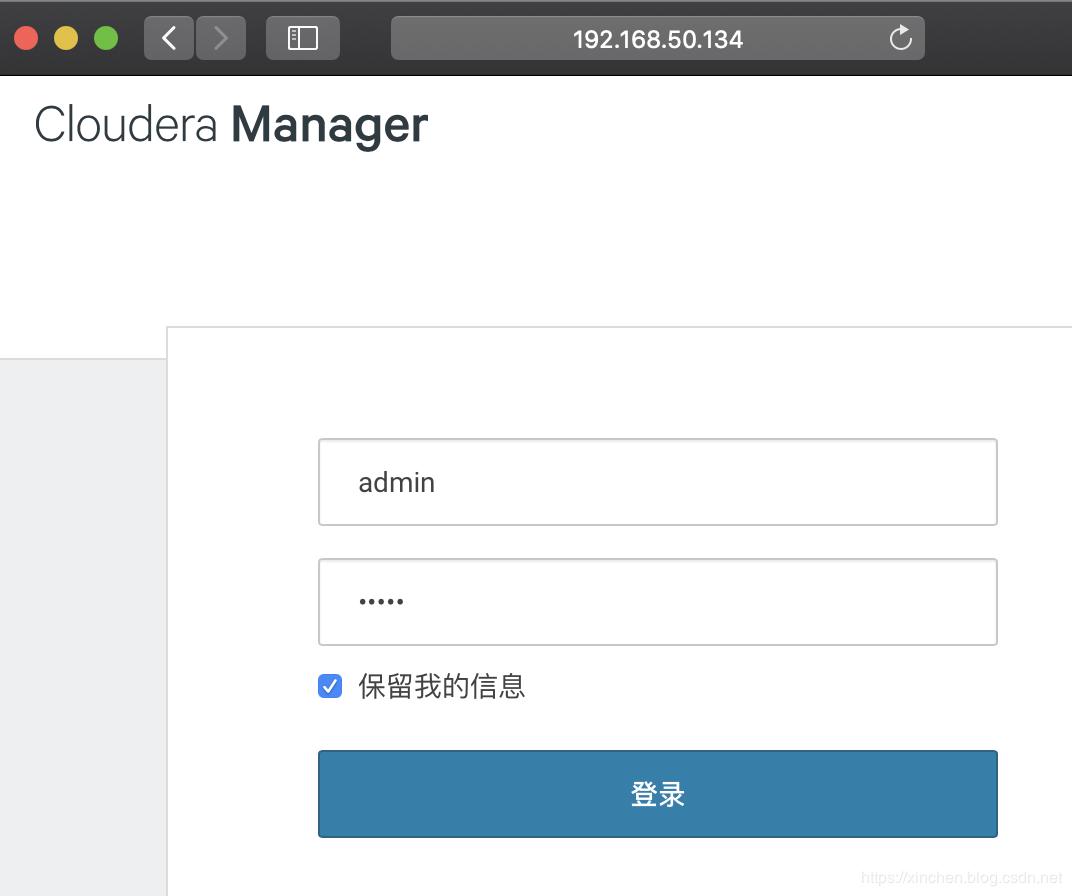

CDH已经启动,CDH服务器对外提供了web服务,可以通过浏览器来操作:

- 浏览器访问:http://192.168.50.134:7180 ,如下图,账号密码都是admin:

- 一路next,在选择版本页面选择60天体验版:

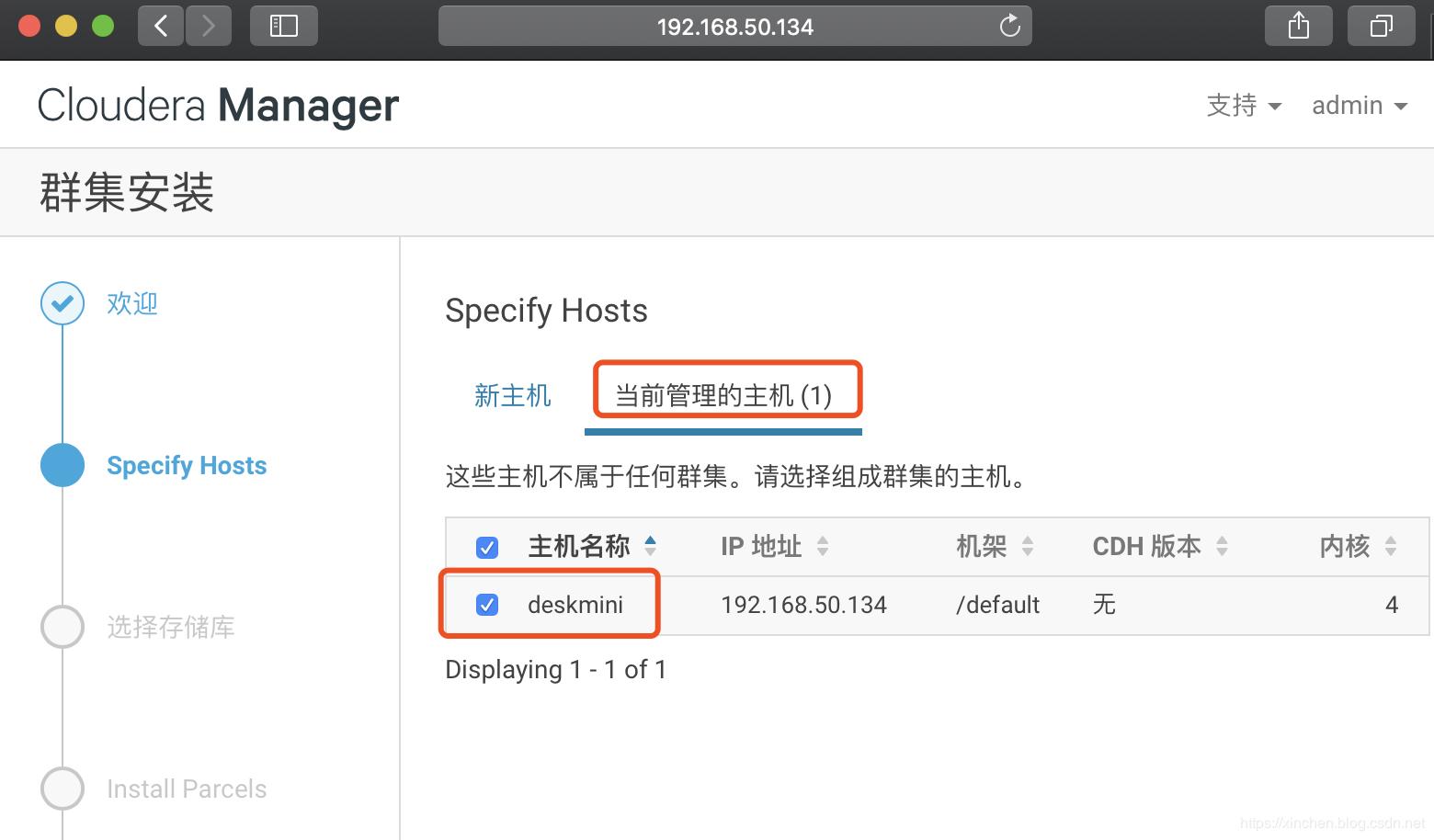

- 选择主机页面可见deskmini:

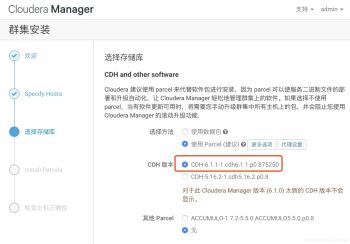

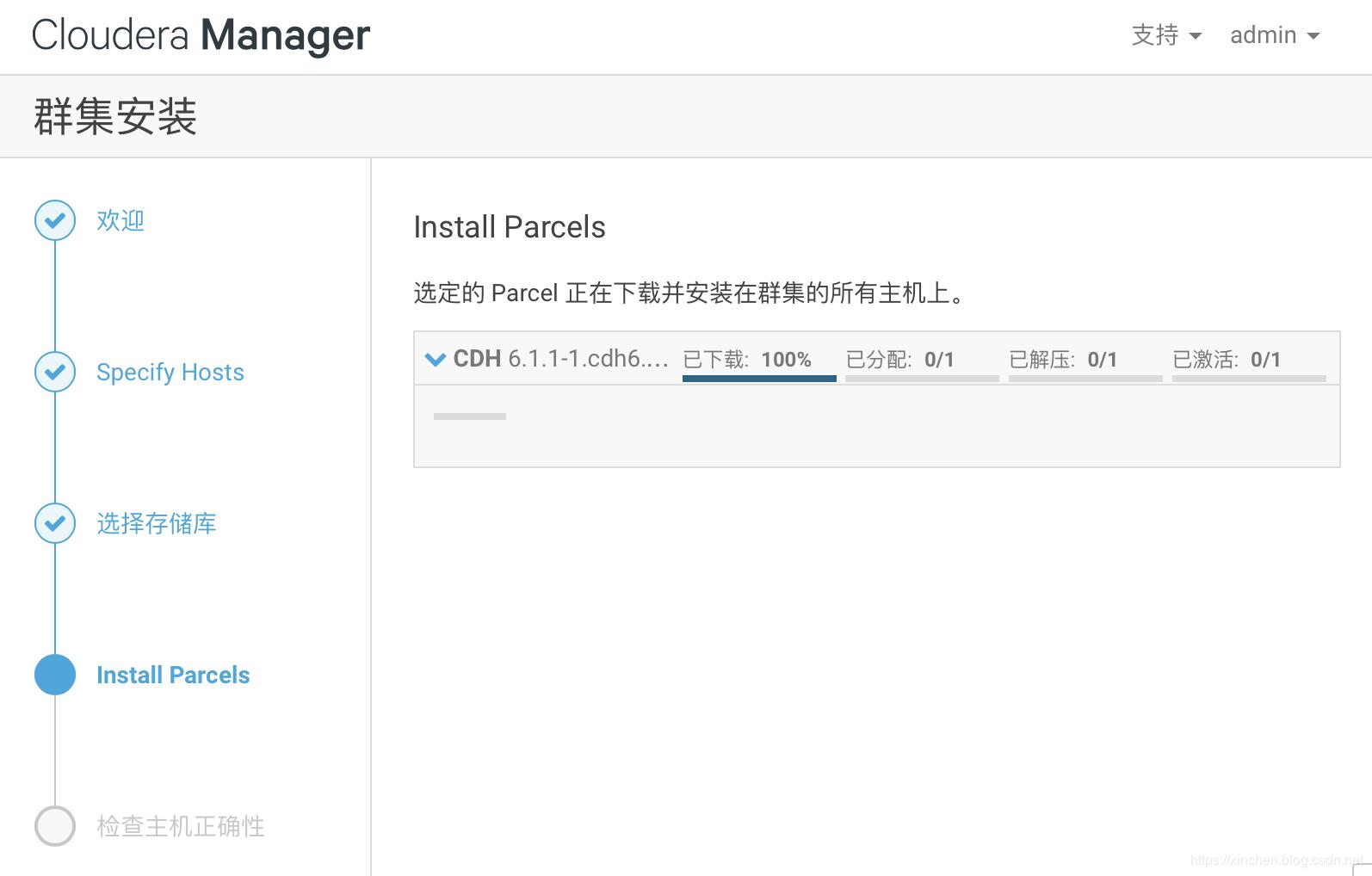

- 选择下图红框中的CDH版本,因为对应的离线包已经复制到CM的本地仓库,无需下载:

- 下载瞬间完成,等候分配、解压、激活:

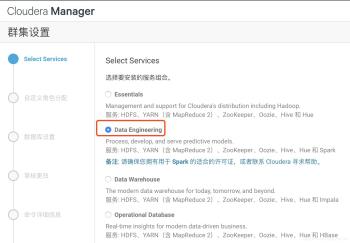

- 选择服务的页面,我这里选择了Data Engineering,因为需要spark:

- 选择机器的页面,全选deskmini:

- 数据库设置页面,请和下图保持一致,数据库主机都是localhost,每个数据库的名称、用户名、密码都相同,分别是:hive、amon、rman、oozie、hue

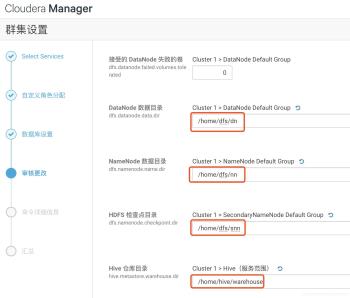

- 参数设置页面,请根据磁盘情况适当调整存储路径,例如我的/home目录空间充足,这里都改到了/home目录下面:

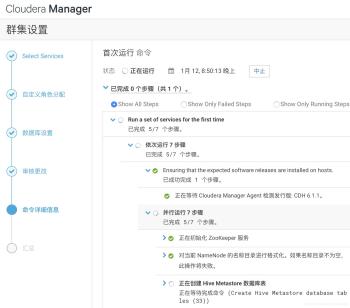

- 等待启动完成:

- 等待启动完成后,如下图所示:

至此,所有服务启动完成,不过有两个小问题需要修复;

修复HDFS问题

- 服务整体情况如下图,HDFS服务有问题,点击红框中的图标:

- 点击下图红框位置:

- 故障详情如下图所示,属于常见的副本不足的问题:

- 如下图所示,修改HDFS的配置dfs.replication,从3改成1,然后保存更改:

- 重启服务:

- 经过上述设置,副本数已经调整为1,但是已有文件的副本数还没有同步,需要重新做设置,SSH登录到电脑deskmini上;

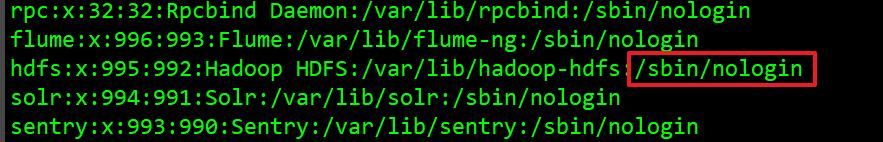

- 执行命令vi /etc/passwd,找到账号hdfs的配置,如下图红框所示,/sbin/nologin这样的shell会导致切换到hdfs账号失败:

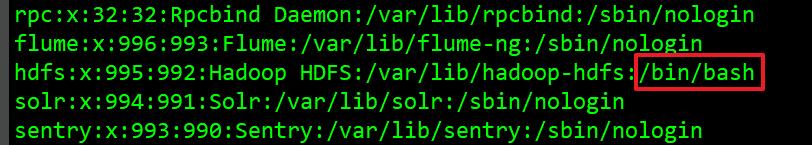

- 将上述红框中的内容改为/bin/bash,修改后如下图红框所示:

- 执行命令su - hdfs,即可切换到hdfs账号,此时执行以下命令即可完成副本数设置:

hadoop fs -setrep -R 1 /- 服务已经全部正常了:

调整YARN参数避免spark-shell启动失败

- YARN默认给容器分配的内存过小,导致启动spark-shell失败,需要调整YARM相关的内存参数:

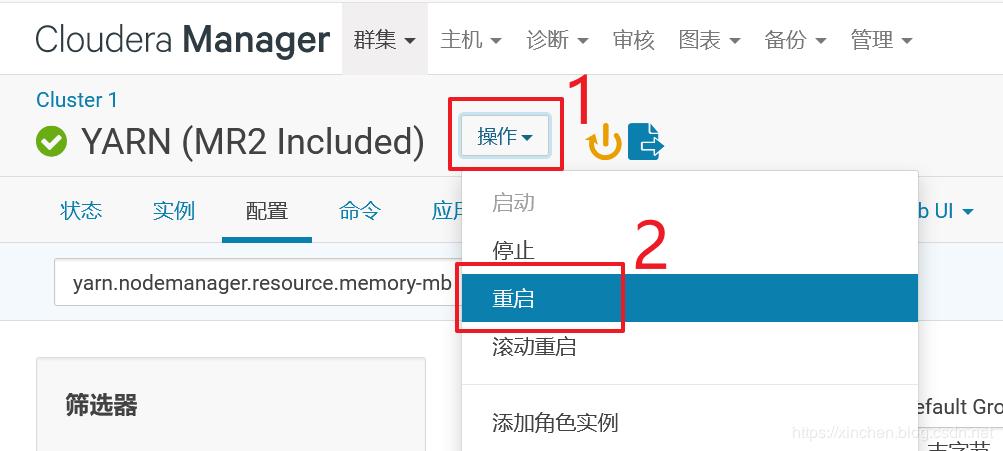

- 在YARN的配置页面,调整yarn.scheduler.maximum-allocation-mb和yarn.nodemanager.resource.memory-mb这两个参数的值,我这里将这个两个参数的值都改成8G(请按照自己电脑实际硬件配置来调整),如下图:

- 重启YARN:

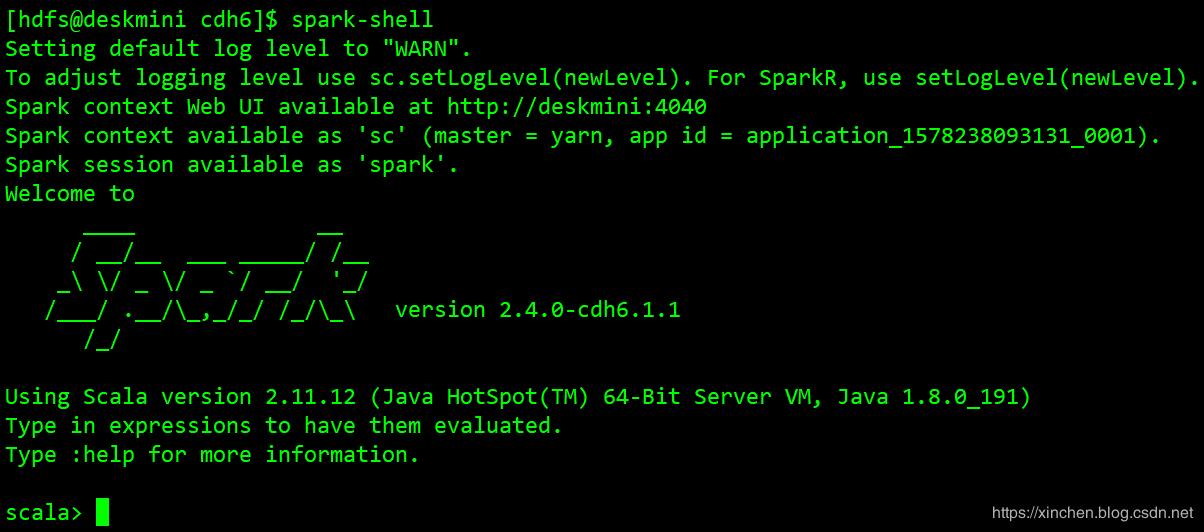

- 执行spark-shell命令之前,先执行命令su - hdfs切换到hdfs账号;

- 这次终于成功进入spark-shell交互模式:

至此,CDH6的部署、启动、设置都已经完成,接下来体验一下大数据服务;

体验HDFS和Spark

接下来运行一个Spark任务,经典的WordCount:

- 准备一份文本文件,里面是英文内容,您可以下载这个文件:https://raw.githubusercontent.com/zq2599/blog_demos/master/files/GoneWiththeWind.txt

- 登录SSH,切换到hdfs账号;

- 创建HDFS文件夹:

hdfs dfs -mkdir /input- 将文本文件上传到/input目录:

hdfs dfs -put ./GoneWiththeWind.txt /input- 执行命令spark-shell,启动一个worker;

- 输入以下命令,即可完成一次WorkCount任务,192.168.50.134是deskmini的IP地址:

sc.textFile("hdfs://192.168.50.134:8020/input/GoneWiththeWind.txt").flatMap(_.split(" ")).map((_,1)).reduceByKey(_+_).saveAsTextFile("hdfs://192.168.50.134:8020/output")- 执行完毕后,下载结果文件:

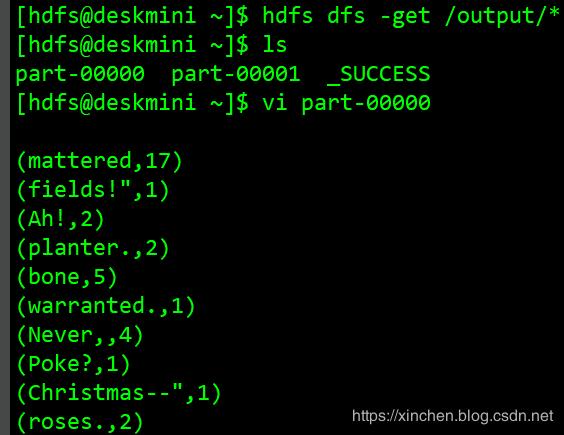

hdfs dfs -get /output/*- 上述命令将spark任务的结果文件part-00000、part-00001下载到本机,用vi命令查看文件,如下图,可见WorkCount执行成功:

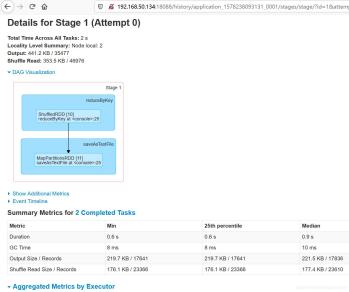

- 在浏览器上查看历史任务,地址是:http://192.168.50.134:18088 ,可见此次任务的详情:

至此,CDH6的部署、设置、体验都已经完成,如果您正在搭建自己的学习或者开发环境,希望本文能给您一些参考。

深度定制

整个实战虽然避免了传统部署过程中的大量手动操作,但弊端也很明显:所有路径、文件名、服务版本都是固定的,不能做任何设置,虽然ansible也支持变量,但是如果变量太多也会给您带来困扰,所以,如果您有修改版本或路径的需求,建议您自行修改cdh-single-install.yml、cdh-single-start.yml的内容,所有文件和版本信息都在里面。